KI in der Industrie 4.0 braucht den Faktor Mensch

Bild: ©Wenjie Dong/istockphoto.com

Intellektuelle Fähigkeiten sind noch Zukunftsmusik

Viele KI-Enthusiasten hoffen auf den Tag – der allerdings noch 20 bis 40 Jahre entfernt sein dürfte – bis eine KI intellektuelle Fähigkeiten haben wird. Vielleicht gelingt es mit Quantencomputern sogar schon früher, noch größere Datenbestände auszuwerten und mit Hilfe von KNN sogar mit einer menschlichen und ethisch orientierten Entscheidungsmatrix zu ertüchtigen. Davon abgesehen, stellen sich aber bei den heutigen Anwendungen schon mit schwacher KI ethische Fragen. Was passiert, wenn eine KI durch Machine Learning diskriminierende Entscheidungen fällt? Heute schon sind erste Lösungen für das Bewerbermanagement bei Recruiting-Prozessen im Einsatz. Bei amerikanischen global agierenden Unternehmen soll es bereits vorgekommen sein, dass Frauen bei der Vorauswahl benachteiligt wurden.

Auch bei Finanzdienstleistern sind KIs im Einsatz, sogar schon länger, als es Chatbots gibt. Mit der ‘falschen Adresse’ oder einem Schufa-Eintrag kann es schon länger passieren, dass eine Versicherung oder ein Kredit verweigert werden. Und wie soll sich ein autonomer und KI-basierter Roboter in einer Smart Factory verhalten, wenn er vor zwei gleich schlechte Alternativen gestellt in beiden Fällen einen menschlichen Kollegen verletzen würde? Mit solchen Fragen beschäftigte sich kürzlich ein Expertengremium der EU, das Ende 2018 seine ethischen Leitlinien zur Diskussion stellte und im April seine finale Version veröffentlichte. Bis Juni 2019 erarbeitete das Gremium eine Handlungsempfehlung für die EU. Nach allem, was bisher bekannt ist, greifen diese Leitlinien aber nicht weit genug. Sie beschreiben einen Weg, “den größtmöglichen Nutzen aus der KI erzielen und gleichzeitig die geringstmöglichen Risiken eingehen.

Um sicherzugehen, dass wir auf dem richtigen Weg bleiben, brauchen wir einen auf den Menschen ausgerichteten (‘menschenzentrierten’) Ansatz für die KI”. Das Gremium hat auch eine Checkliste mit Fragen für Anbieter von KI entwickelt, wie sie ihre Systeme sicher betreiben können. Leider aber fehlen Empfehlungen an die EU-Kommission, welche Mindestanforderungen und Sicherheitsauflagen sie den KI-Betreibern auferlegen sollten, damit der Mensch als Gestalter und Nutznießer der digitalen Transformation wirklich im Fokus bleibt. Denn eines ist klar: Eine wirtschaftlich oder aus Sicht von Behörden erfolgreiche KI werden Betreiber nicht ändern, nur weil sie ein wenig diskriminierend agiert.

Der Mensch muss am längeren Hebel sitzen

Hier müssen die EU und internationale Institutionen wie die UN klare Regeln aufstellen und anordnen, dass externe Institutionen die Einhaltung regelmäßig überprüfen dürfen. Eine notwendige Regel wäre z.B., dass immer dann, wenn eine KI mit einem Menschen interagiert, diese als solche ausgewiesen wird und der menschliche Kollege z.B. durch Notausschalter immer am längeren Hebel sitzt.

Oder im Falle, dass eine KI Entscheidungsbefugnisse erhält, muss der Mensch das Recht erhalten, eine natürliche Person wie z.B. den Betriebsrat oder eine andere verantwortliche Stelle im Unternehmen mit der Überprüfung einer KI-Entscheidung zu beauftragen. Darüber hinaus müssen die Betreiber bei einer KI mit Machine Learning verpflichtet sein, ihre sich selbständig umschreibenden Algorithmen durch Testläufe zu überwachen. Bei einem KI-basierten Roboter sollten die Unternehmen schon aus Gründen der Betriebssicherheit ihren Algorithmen regelmäßig einer Prüfung unterziehen. Und weil es Menschen sind, die KI-Algorithmen schreiben, sollten diese durch Weiterbildung ihre Kompetenzen als Fachleute regelmäßig vertiefen müssen.

Eigener Ethikrat

Denkbar wäre auch, wenn große Unternehmen einen eigenen Ethikrat mit externen Experten gründen, der die Weiterentwicklung der Anwendungen überwacht. Auch und vor allem beim KI-Einsatz staatlicher Stellen sind Sicherheitslinien einzubeziehen, die nicht überschritten werden dürfen. So sehr sich auch Verwaltungshandeln künftig mittels KI vereinfachen lassen dürfte, müssen staatliche Stellen ein enges Korsett erhalten, um Freiheitsrechte der Bürger nicht schleichend einzuschränken.

Das könnte Sie auch interessieren

Carbon Management-Technologien stehen im Fokus, um CO2-Emissionen zu reduzieren und zu managen. Die Rolle des Maschinenbaus und mögliche Entwicklungspfade betrachtet eine neue Studie des VDMA Competence Center Future Business.‣ weiterlesen

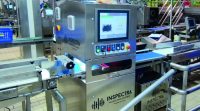

Hohe Geschwindigkeit und hohe Erkennungsraten sind die Anforderungen an die Qualitätskontrolle in der Verpackungsbranche. Wie diese Anforderungen erreicht werden können, zeigt das Unternehmen Inndeo mit einem Automatisierungssystem auf Basis von industrieller Bildverarbeitung und Deep Learning.‣ weiterlesen

Jeder zweite Betrieb investiert laut einer Betriebsräte-Befragung der IG Metall zu wenig am Standort. Demnach verfügen rund 48 Prozent der Unternehmen über eine Transformationsstrategie. Zudem sehen die Betriebsräte ein erhöhtes Risiko für Verlagerungen.‣ weiterlesen

Ob es sich lohnt, ältere Maschinen mit neuen Sensoren auszustatten, ist oft nicht klar. Im Projekt 'DiReProFit' wollen Forschende dieses Problem mit künstlicher Intelligenz zu lösen.‣ weiterlesen

Ziel des neuen VDMA-Forums Manufacturing-X ist es, der zunehmenden Bedeutung von Datenräumen als Basis für neue, digitale Geschäftsmodelle Rechnung zu tragen. Wie der Verband mitteilt, soll das Forum auf dem aufbauen, was in der letzten Dekade durch das VDMA-Forum Industrie 4.0 erarbeitet wurde. ‣ weiterlesen

Wie kann eine Maschine lernen, sich in unserer Lebenswelt visuell zu orientieren? Mit dieser Frage setzen sich die Wissenschaftler am Deutschen Forschungsinstitut für Künstliche Intelligenz (DFKI) aktuell auseinander – und entwickeln Lösungen.‣ weiterlesen

Die seit 2020 geltende staatliche Forschungszulage etabliert sich im deutschen Maschinen- und Anlagenbau mehr und mehr als Instrument der Forschungsförderung. Ein wachsender Anteil der Unternehmen nutzt die Forschungszulage. Besonders geschätzt werden die verbesserten Finanzierungsmöglichkeiten sowie der erleichterte Zugang zur staatlichen Förderung von Forschung und Entwicklung (FuE).‣ weiterlesen

Der Nutzen neuer Technologien kommt nur dann zum Tragen, wenn diese von den Menschen mindestens toleriert, besser aber gesamtgesellschaftlich angenommen werden. Dafür braucht es Dialog und Möglichkeiten für gemeinsame Gestaltung. Welche Kommunikationsformate sich hierfür eignen und welche Wirkung sie bei den Beteiligten erzielen, das hat das Acatech-Projekt 'Technologischen Wandel gestalten' bei den Themen elektronische Patientenakte, digitale Verwaltung und Katastrophenschutz untersucht. Jetzt hat das Projektteam die Ergebnisse vorgelegt.‣ weiterlesen

Der Fachkräftemangel erfordert einen möglichst intelligenten und flexiblen Personaleinsatz. KI spielt dabei eine wichtige Rolle. Der Industriesoftware-Spezialist Augmentir zeigt sechs Ansatzmöglichkeiten auf.‣ weiterlesen

Eine aktuelle Studie von Reichelt Elektronik betrachtet den aktuellen Stand der Digitalisierung und stellt die Frage, wie Deutschland im Vergleich zu anderen europäischen Ländern abschneidet.‣ weiterlesen

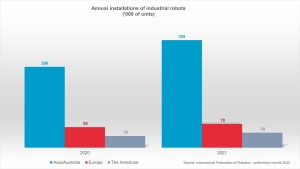

Können Roboter dabei helfen, dem Fachkräftemangel in der Logistik-Branche Herr zu werden? Der Branchenverband IFR meint ja - und zwar mit Hilfe von Robotik, die durch künstliche Intelligenz unterstützt wird.‣ weiterlesen