Studie der TU Darmstadt

Künstliche Intelligenz erlernt menschliche Moral

Künstliche Intelligenz (KI) übersetzt Texte, schlägt Behandlungen für Patienten vor, trifft Kaufentscheidungen und optimiert Arbeitsabläufe. Aber wo ist ihr moralischer Kompass? Eine Studie des Centre for Cognitive Science der TU Darmstadt zeigt, dass KI-Maschinen von Menschen lernen können, wie Entscheidungen in moralischen Fragen zu fällen sind.

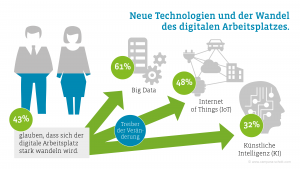

KI ist von zunehmender Bedeutung in unserer Gesellschaft. Von selbstfahrenden Autos auf öffentlichen Straßen über selbst-optimierende, industrielle Produktionssysteme bis hin zur Altenpflege und der Medizin – KI-Maschinen bewältigen immer komplexere menschliche Aktivitäten auf immer autonomere Weise. Und in Zukunft werden autonome Maschinen in immer mehr Bereichen unseres täglichen Lebens auftauchen. Zwangsläufig werden sie dabei mit schwierigen Entscheidungen konfrontiert.

Zeit totschlagen, aber keine Menschen

Ein autonomer Roboter muss wissen, dass er Menschen nicht, Zeit aber sehr wohl totschlagen darf. Er muss wissen, dass man Brot toastet, jedoch keine Hamster. KI braucht also einen menschenähnlichen Moral-Kompass. Aber kann sie einen solchen Kompass von uns Menschen überhaupt erlernen? Forscher aus Princeton (USA) und Bath (UK) hatten bereits auf die Gefahr hingewiesen, dass KI bei unreflektierter Anwendung kulturelle Stereotype oder Vorurteile aus Texten erlernt: Beispielsweise wurden weibliche Namen eher mit Kunst und männliche Namen eher mit Technik verknüpft. Die künstliche Intelligenz zieht diese Vorurteile aus sehr großen Textmengen aus dem Internet. Diese werden benutzt, um neuronale Netzwerke so zu trainieren, dass sie die Bedeutung von Wörtern in Koordinaten, also Punkte, in einem hochdimensionalen Raum ‘übersetzen’. Die semantische Nähe zweier Wörter zueinander kann dann durch die Distanz ihrer Koordinaten, die sogenannten Worteinbettungen, ausgedrückt werden. So lassen sich komplexe semantische Zusammenhänge durch Arithmetik berechnen und beschreiben. Das gilt nicht nur für das unverfängliche Beispiel ‘König – Mann + Frau = Königin’, sondern auch für das diskriminierende ‘Mann – Technik + Kunst = Frau’.

Richtiges und falsches Handeln lernen

Einem Team um Professor Kristian Kersting und Professor Constantin Rothkopf am Centre for Cognitive Science der TU Darmstadt ist es nun gelungen zu zeigen, dass auch deontologische, ethische Überlegungen über richtiges und falsches Handeln aus großen Textdatenmengen gelernt werden können. Dazu erstellten die Wissenschaftler Listen von Frage-Antwort-Schemata für verschiedene Handlungen. Die Fragen lauten z.B. “Sollte ich Menschen töten?” oder “Sollte ich Menschen ermorden?”, die möglichen Antworten beispielsweise “Ja, sollte ich”, “Nein, sollte ich nicht”. Durch die Analyse von Texten menschlichen Ursprungs bildete das KI-System im Experiment dann eine menschenähnliche, moralische Ausrichtung heraus. Das System berechnet die Einbettungen der gelisteten Fragen und möglichen Antworten im Textkorpus und prüft, welche Antworten aufgrund aller Nennungen näher bei den Fragen stehen, also gemeinhin als moralisch korrekt angesehen werden dürften. So lernte die künstliche Intelligenz im Experiment, dass man nicht lügen sollte und dass es besser ist, seine Eltern zu lieben, als eine Bank auszurauben. Und ja, man soll Menschen nicht töten, es ist aber in Ordnung, Zeit totzuschlagen. Die Untersuchung liefert ein wichtiges Indiz für eine grundlegende Frage der künstlichen Intelligenz: Können Maschinen einen Moral-Kompass entwickeln? Und wenn ja, wie kann man Maschinen effektiv unsere Moral ‘beibringen’? Die Ergebnisse zeigen, dass Maschinen unsere Werte widerspiegeln können. Sie können menschliche Vorurteile übernehmen, sie können aber auch durch das ‘Beobachten’ von Menschen und den von ihnen geschriebenen Texten Moralvorstellungen übernehmen. Die Untersuchung von Einbettungen von Fragen und Antworten kann als Methode gleichsam wie ein Mikroskop verwendet werden, um die moralischen Werte von Textsammlungen und auch den zeitlichen Verlauf von Moralvorstellungen in der Gesellschaft zu untersuchen. Die Erkenntnisse aus der Studie können künftig einen wichtigen Beitrag leisten, wenn es darum geht, maschinell gelernte Inhalte in Systeme einzubauen, die Entscheidungen treffen müssen.

Das könnte Sie auch interessieren

Vom 22. bis zum 26. April wird Hannover zum Schaufenster für die Industrie. Neben künstlicher Intelligenz sollen insbesondere Produkte und Services für eine nachhaltigere Industrie im Fokus stehen.‣ weiterlesen

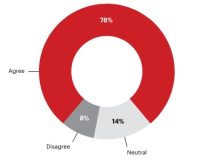

Eine Umfrage von Hewlett Packard Enterprise (HPE) unter 400 Führungskräften in Industrie-Unternehmen in Deutschland zeigt, dass zwei Drittel der Befragten den Data Act als Chance wahrnehmen. Der Data Act stieß unter anderem bei Branchenverbänden auf Kritik.‣ weiterlesen

Carbon Management-Technologien stehen im Fokus, um CO2-Emissionen zu reduzieren und zu managen. Die Rolle des Maschinenbaus und mögliche Entwicklungspfade betrachtet eine neue Studie des VDMA Competence Center Future Business.‣ weiterlesen

Deutsche Unternehmen nehmen eine zunehmende Bedrohung durch Cyber-Angriffe wahr. Das zeigt eine aktuelle Umfrage vom Markt- und Meinungsforschungsinstitut YouGov im Auftrag von 1&1 Versatel, an der mehr als 1.000 Unternehmensentscheider teilnahmen.‣ weiterlesen

Hohe Geschwindigkeit und hohe Erkennungsraten sind die Anforderungen an die Qualitätskontrolle in der Verpackungsbranche. Wie diese Anforderungen erreicht werden können, zeigt das Unternehmen Inndeo mit einem Automatisierungssystem auf Basis von industrieller Bildverarbeitung und Deep Learning.‣ weiterlesen

Laut einer Studie der Unternehmensberatung Bain & Company könnten Unternehmen ihre Produktivität durch digitale Tools, Industrie 4.0-Technologien und Nachhaltigkeitsmaßnahmen steigern. Deren Implementierung von folgt oft jedoch keiner konzertierten Strategie.‣ weiterlesen

Jeder zweite Betrieb investiert laut einer Betriebsräte-Befragung der IG Metall zu wenig am Standort. Demnach verfügen rund 48 Prozent der Unternehmen über eine Transformationsstrategie. Zudem sehen die Betriebsräte ein erhöhtes Risiko für Verlagerungen.‣ weiterlesen

Ziel des neuen VDMA-Forums Manufacturing-X ist es, der zunehmenden Bedeutung von Datenräumen als Basis für neue, digitale Geschäftsmodelle Rechnung zu tragen. Wie der Verband mitteilt, soll das Forum auf dem aufbauen, was in der letzten Dekade durch das VDMA-Forum Industrie 4.0 erarbeitet wurde. ‣ weiterlesen

Ob es sich lohnt, ältere Maschinen mit neuen Sensoren auszustatten, ist oft nicht klar. Im Projekt 'DiReProFit' wollen Forschende dieses Problem mit künstlicher Intelligenz zu lösen.‣ weiterlesen

Wie kann eine Maschine lernen, sich in unserer Lebenswelt visuell zu orientieren? Mit dieser Frage setzen sich die Wissenschaftler am Deutschen Forschungsinstitut für Künstliche Intelligenz (DFKI) aktuell auseinander – und entwickeln Lösungen.‣ weiterlesen

Die seit 2020 geltende staatliche Forschungszulage etabliert sich im deutschen Maschinen- und Anlagenbau mehr und mehr als Instrument der Forschungsförderung. Ein wachsender Anteil der Unternehmen nutzt die Forschungszulage. Besonders geschätzt werden die verbesserten Finanzierungsmöglichkeiten sowie der erleichterte Zugang zur staatlichen Förderung von Forschung und Entwicklung (FuE).‣ weiterlesen

Exklusiv für Abonnenten

Exklusiv für Abonnenten