Der Human Digital Twin

Drei Schichten

Letztend Endes besteht der Human Digital Twin aus drei Schichten:

- • Eine digitale Abbildung der Mitarbeitenden in den Werks- und Lagerhallen, die die Aktivitäten in anonymisierter und aggregierter Form darstellt.

- • Eine Visualisierung der Produktionsumgebung, um Arbeitsstationen zu erfassen mit der Option, diese miteinander zu vergleichen.

- • Einen virtuellen Industrie-Analysten, der etwa Muster erkennt und Blocker identifiziert.

Unternehmen können ihre Produktivität, aber auch ihre Effizienz und Auslastung evaluieren. Eine Kenngröße bilden hier Time-Motion-Analysen für die zugewiesenen Aufgaben. Die Anzahl der Scans lässt sich beispielsweise mit der Anzahl der Arbeitsschritte korrelieren, um die Auslastung der jeweiligen Mitarbeitenden zu bestimmen. Auf diese Weise können Unternehmen u.a. auch beurteilen, ob die Anzahl der zugewiesenen Bschädftigten pro Arbeitsstation angepasst werden muss. Da der Human Digital Twin Gerätedaten im Kontext ihrer Umgebung darstellen kann, lassen sich z.B. auch die tägliche Leistung pro Standort oder pro Arbeitsstation nachvollziehen. Somit können die Beschäftigten erkennen, ob sie ihre täglichen Ziele erreichen oder ob Anpassungen notwendig sind. Denn damit können die Verantwortlichen eindeutige, umsetzbare Schlussfolgerungen zu zeitlich abgegrenzter Arbeitsleistung und -aufwänden ziehen und Bewegungsmuster bestimmten Teilaufgaben zuordnen. Gleichzeitig werden aber auch Takt- und Laufzeiten erkennbar, Aktivitäten lassen sich in Prozessschritte zusammenfassen, es entsteht ein Bild der digitalen Produktionsumgebung.

Transparenz und Aufklärung sind essenziell

Der Human Digital Twin soll den Menschen schützen und ihn unterstützen. Darum ist es wichtig, dass neben den Effizienzgewinnen auch die Aufklärung über die Datennutzung stattfindet. Er soll keine Überwachungslösung sein, die personalisierte Daten sammelt. Das Modell des Human Digital Twin spiegelt vielmehr den Menschen in der Produktion- und Logistikumgebung auf Basis anonymisierter Daten. Ziel ist es, wiederkehrende Muster zu erkennen. Der Human Digital Twin ermöglicht eine Auswertung von Wegzeiten im Lager sowie potenzieller Gefahren. Darin verbirgt sich großes Optimierungspotenzial, das die Produktion nicht nur effizienter, sondern auch sicherer macht. Das stellt den Job in Bezug zum Aufwand und ermöglicht es Unternehmen auch, für die richtige Mitarbeiterplanung zu sorgen.

Bottom-Up-Daten auswerten

Mit dem neuen Modell können Unternehmen erstmals wirklich Bottom-Up-Daten sammeln und auswerten. Eben das fehlt bislang und ist somit eine wichtige Ergänzung zu den bisherigen Top-Down-Informationen aus den gängigen Enterprise Applikationen.

Das könnte Sie auch interessieren

Für das aktuelle Allianz Risk Barometer wurden 3000 Risikoexperten befragt. Das Ergebnis: Als größte Risiken nennen die Teilnehmer Datenpannen, Angriffe auf kritische Infrastruktur oder Vermögenswerte und vermehrte Ransomware-Attacken. Anders als weltweit schafft es der Fachkräftemangel in Deutschland auf Platz 4.‣ weiterlesen

In Potsdam laufen die Vorbereitungen für eine vollständig digitale Universität. Die beiden Initiatoren Mike Friedrichsen und Christoph Meinel wollen damit dem IT-Fachkräftemangel entgegenwirken.‣ weiterlesen

@Grundschrift_NH:Nvidias Omniverse lässt sich künftig über T-Systems beziehen. Die Plattform der Grafik-Spezialisten ermöglicht es, komplexe 3D-Pipelines und Universal Scene Description (OpenUSD)-Anwendungen für Industrieanwendungen zu entwickeln und anzubinden. So können Unternehmen ihre 3D-Werkzeuge und -Daten mit dem Open-USD-Standard vereinheitlichen, um Teams über ihre PCs in bis zu fotorealistischen Visualisierungen und Simulationen zusammenzubringen. ‣ weiterlesen

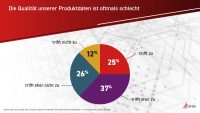

Sechs von zehn Unternehmen sind mit der Qualität ihrer Produktdaten unzufrieden. Das zeigt eine europaweite Befragung des Softwareherstellers Aras unter mehr als 440 Entscheidern. Zudem ergab die Untersuchung, dass Informationen, die eigentlich abteilungsübergreifend zugänglich sein sollten, oft ungenutzt in abgeschotteten Unternehmensbereichen liegen.‣ weiterlesen

Der Anteil der Unternehmen, die KI einsetzen, ist binnen eines Jahres von 9 auf 15 Prozent gestiegen. Das ist das Ergebnis einer Bitkom-Befragung unter 605 Unternehmen. Zwei Drittel von ihnen sehen KI als wichtigste Zukunftstechnologie.‣ weiterlesen

Derzeit erleben wir multiple Krisen - neben zunehmenden geopolitischen Spannungen entwickelt sich die Erderwärmung zu einer immer größeren Herausforderung. Das Umweltbundesamt rechnet bis Ende des 21. Jahrhunderts mit einer Erhöhung der mittleren Erdtemperatur um bis zu 5,7 Grad Celsius, sofern nicht kurzfristig eine massive Reduktion der CO2-Emissionen erfolgt. Wie der CO2-Fußabdruck dabei unterstützen kann, beschreibt ein Beitrag des Beratungsunternehmens Aflexio.‣ weiterlesen

Mit bestehenden Geothermiebohrungen im Oberrheingraben könnte zuverlässig Lithium gefördert werden. Das zeigen aktuelle Datenanalysen von Forschenden des Karlsruher Instituts für Technologie (KIT). Frisches Tiefenwasser sorgt über mehrere Jahrzehnte für Nachschub. ‣ weiterlesen

Mit einem messdatengestützten Retrofit-System können ältere Windkraftanlagen länger laufen. Im von Bachmann Monitoring und P. E. Concepts entwickelten System fließen erfasste Last- und Eigenfrequenzdaten in die Lebensdauer-Berechnung von Komponenten ein. Anhand dieser Daten lässt sich eine realistischere Restnutzungsdauer errechnen, um den rentablen Weiterbetrieb zu ermöglichen. ‣ weiterlesen