Umfrage zu generativer KI

Chance versus Risiko

Laut einer Umfrage des TÜV-Verbands sorgt sich die Bevölkerung vor unkalkulierbaren Risiken, Fake-News-Schwemmen und Arbeitsplatzverlusten im Zusammenhang mit generativer künstlicher Intelligenz. 84 Prozent fordern gesetzliche Vorgaben für KI-Anwendungen.

TÜV-Verband e. V.

Anwendungen mit generativer Künstlicher Intelligenz (KI) wie etwa ChatGPT verbreiten sich rasant, verursachen aber auch erhebliche Sorgen in der Bevölkerung: Seit der Einführung im November haben schon 83 Prozent der Deustchen von ChatPT gehört. 23 Prozent haben das Tool bereits für berufliche oder private Zwecke genutzt. Das hat eine repräsentative Forsa-Umfrage im Auftrag des TÜV-Verbands unter 1.021 Personen ab 16 Jahren ergeben.

„Seit seiner Einführung zeigt ChatGPT eindrucksvoll, welches enorme Potenzial künstliche Intelligenz hat“, sagte Dr. Joachim Bühler, Geschäftsführer des TÜV-Verbands, bei Vorstellung der Studienergebnisse. ChatGPT zeige aber auch, welche Risiken mit dem Einsatz von künstlicher Intelligenz verbunden seien. So stimmen 80 Prozent der Befragten der Aussage zu, dass beim Einsatz von KI derzeit nicht abschätzbare Risiken bestehen. Fast zwei von drei befürchten, dass die Technologie für Menschen nicht mehr beherrschbar ist (65 Prozent) oder dass sie ohne ihr Wissen manipuliert werden könnten (61 Prozent). Und 76 Prozent haben Bedenken, dass KI persönliche Daten nicht ausreichend schützt.

„Es muss sichergestellt werden, dass KI-Anwendungen Menschen nicht körperlich verletzen oder benachteiligen“, sagte Bühler, der in der geplanten EU-KI-Verordnung eine Chance sieht, einen Rechtsrahmen für die ethische und sichere Nutzung von künstlicher Intelligenz in der EU zu schaffen. In der Studie befürworten 84 Prozent der Befragten gesetzliche Vorgaben für KI-Anwendungen.

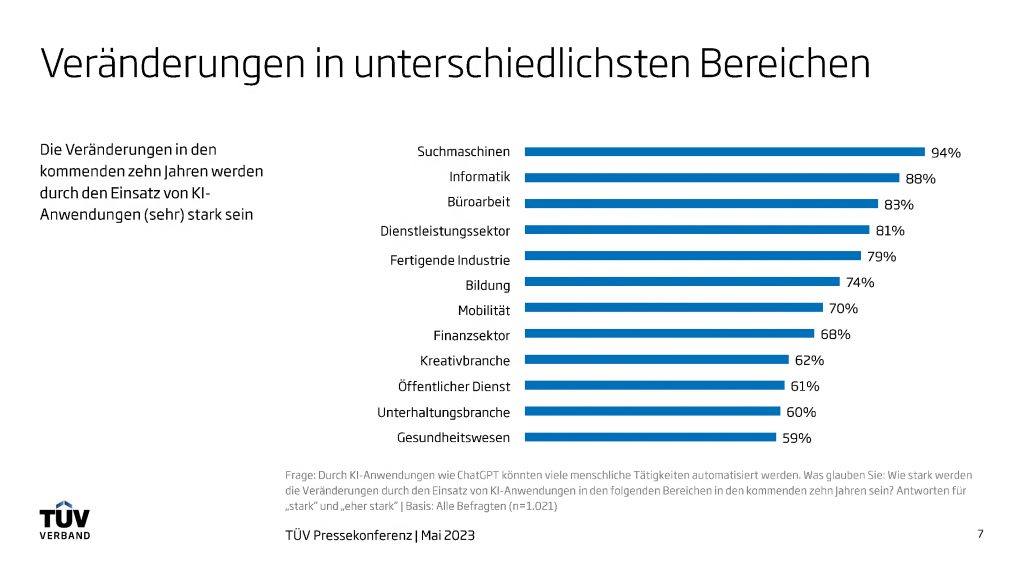

Große Auswirkungen auf die Arbeitswelt

Was die Chancen und Risiken der Technologie angeht, sind die Meinungen geteilt. 50 Prozent sind der der Ansicht, dass unter dem Strich die Chancen die Risiken übersteigen. 39 Prozent sind nicht dieser Meinung und 12 Prozent sind unentschlossen. „Weitreichende Folgen wird künstliche Intelligenz für den Arbeitsmarkt haben“, sagte Bühler. 87 Prozent der Befragten gehen davon aus, dass KI die Arbeitswelt grundlegend verändern wird. Etwa die Hälfte glaubt, dass sehr viele Menschen als Folge des KI-Einsatzes ihren Job verlieren werden (48 Prozent). Allerdings machen sich derzeit nur 15 Prozent Sorgen, dass KI-Systeme ihre eigene berufliche Tätigkeit ersetzen werden. Viele der Befragten erwarten sogar Vorteile. So stimmt jeder zweite stimmt der Aussage zu, dass KI das Potenzial hat, ihn oder sie in ihrem Beruf zu unterstützen (50 Prozent). „Ein wahrscheinliches Szenario ist, dass KI-Anwendungen als digitale Assistenten die Beschäftigten bei der Bewältigung unterschiedlichster Aufgaben unterstützen werden“, sagte Bühler. Das gelte sowohl für Büroarbeiten als auch für die Planung und Durchführung manueller Tätigkeiten.

Gefahren für Mediensystem und Demokratie

Große Sorgen bereitet der Bevölkerung die Auswirkungen von generativen KI-Anwendungen für das Mediensystem und unser politisches System. Gut geben 51 Prozent an, dass die Technologie eine Gefahr für die Demokratie sei. Dabei gehe es etwa um Falschnachrichten, Propaganda und manipulierte Bilder, Texte und Videos, so Bühler. Laut Umfrage gehen 84 Prozent der Befragten davon aus, dass KI die Verbreitung von ‘Fake News’ massiv beschleunigen werde. 91 Prozent glauben, dass kaum noch erkennbar sein wird, ob Fotos oder Videos echt oder gefälscht sind. Und gut zwei von drei Befragten fürchten, dass KI die Verbreitung staatlicher Propaganda massiv beschleunigen wird (69 Prozent). Bühler: „Mit Künstlicher Intelligenz erstellte Inhalte werden die demokratischen Gesellschaften vor enorme Herausforderungen stellen.“

Forderung nach rechtlichem Rahmen

91 Prozent der Befragten fordern, dass der Gesetzgeber einen rechtlichen Rahmen für den sicheren Einsatz von KI schaffen sollte. Dabei sollte sich die Regulierung und Nutzung von KI in der EU an europäischen Werten orientieren, sagen 83 Prozent. Nur 16 Prozent sind dagegen der Meinung, dass man KI derzeit nicht regulieren und die ethische Entwicklung den Tech-Unternehmen überlassen sollte. 94 Prozent sprechen sich zudem für eine Kennzeichnungspflicht für automatisiert bzw. mit KI-Unterstützung erzeugte Inhalte aus, 88 Prozent für eine Kennzeichnung, dass KI in einem Produkt oder einer Anwendung ‘enthalten’ ist, und 86 Prozent fordern eine verpflichtende Prüfung der Qualität und Sicherheit von KI-Systemen durch unabhängige Prüforganisationen.

EU als Vorreiter?

Aus Sicht des TÜV-Verbands leitet sich daraus ein klarer Handlungsauftrag für die Politik ab. „Mit dem AI Act ist die EU globaler Vorreiter bei der Gesetzgebung in den demokratisch organisierten Wirtschaftsblöcken“, sagte Bühler und sprach sich für klare am Risiko orientierte Regeln aus. „Mit einer intelligenten Regulierung können wir einen internationalen Standard für innovative und wertebasierte KI setzen.“

Der Entwurf des AI Acts sieht vor, KI-Anwendungen in vier Risikoklassen einzuteilen. Die geplanten Regelungen reichen von einem Verbot für KI-Anwendungen mit einem ‘unannehmbaren Risiko’ wie etwa Social Scoring bis zu keinerlei Vorgaben für Anwendungen mit ‘minimalem Risiko’ wie Spamfiltern oder Games. Bühler schätzt, dass etwa 80 Prozent der Anwendungen unter diese Kategorie fallen. KI-Systeme mit einem ‘begrenzten Risiko’ wie einfache Chatbots müssen bestimmte Transparenz- und Kennzeichnungspflichten erfüllen. Für KI-Anwendungen mit einem ‘hohen Risiko’, etwa in kritischen Infrastrukturen, Software im Personalwesen oder bestimmte KI-basierte Roboter, gelten strenge Sicherheitsanforderungen. Diese müssen neben Transparenzpflichten auch Anforderungen wie die Erklärbarkeit ihrer Ergebnisse oder Diskriminierungsfreiheit erfüllen. Bühler: „Vor ihrer Markteinführung sollten alle Hochrisiko-KI-Systeme von einer unabhängigen Stelle überprüft werden. Nur so kann sichergestellt werden, dass die Anwendungen den Sicherheitsanforderungen entsprechen.“

Das könnte Sie auch interessieren

Werkzeugbahnen für Zerspanprozesse in CAM-Systemen zu planen erfordert Expertenwissen. Viele Parameter müssen bestimmt und geprüft werden, um die Bahnplanung Schritt für Schritt zu optimieren. Im Projekt CAMStylus arbeiten die Beteiligten daran, diese Aufgabe zu vereinfachen - per KI-gestützter Virtual-Reality-Umgebung.‣ weiterlesen

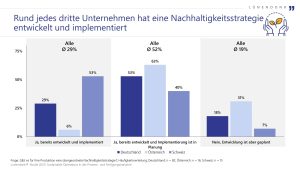

In einer Studie von Techconsult in Zusammenarbeit mit Grandcentrix wurden 200 Unternehmen ab 250 Beschäftigten aller Branchen zum Thema ESG in ihren Unternehmen befragt. Die Studie hebt die zentrale Rolle der jüngsten CSR-Direktive der EU bei der Förderung von Transparenz und Nachhaltigkeit in Unternehmen hervor. Dabei beleuchtet sie die Fortschritte und Herausforderungen bei der Umsetzung von Umwelt-, Sozial- und Unternehmensführungskriterien (ESG) im Zusammenhang mit der Nutzung von IoT-Technologien.‣ weiterlesen

AappliedAI hat vier KI Use Cases identifiziert, die es dem produzierenden Gewerbe ermöglichen, ihre Effizienz und Produktivität zu steigern. Mit der Anwendung bewährter Technologien können sich die Investitionen bereits nach einem Jahr amortisieren.‣ weiterlesen

Hinter jedem erfolgreichen Start-up steht eine gute Idee. Bei RockFarm sind es gleich mehrere: Das Berliner Unternehmen baut nachhaltige Natursteinmauern aus CO2 bindendem Lavagestein. Oder besser gesagt, es lässt sie bauen - von einem Yaskawa-Cobot HC10DTP.‣ weiterlesen

Mit über 2,2Mio.t verarbeitetem Schrott pro Jahr ist die Swiss Steel Group einer der größten Recyclingbetriebe Europas. Für seinen 'Green Steel', also Stahl aus recyceltem Material, arbeitet das Unternehmen an einem digitalen Zwilling des ankommenden Schrotts.‣ weiterlesen

Laut einer aktuellen Studie von Hitachi Vantara betrachten fast alle der dafür befragten Unternehmen GenAI als eine der Top-5-Prioritäten. Aber nur 44 Prozent haben umfassende Governance-Richtlinien eingeführt.‣ weiterlesen

61 Prozent der Unternehmen in Deutschland wollen laut einer Bitkom-Befragung per Cloud interne Prozesse digitalisieren, vor einem Jahr waren es nur 45 Prozent. Mittelfristig wollen die Unternehmen mehr als 50 Prozent ihrer Anwendungen in die Cloud verlagern.‣ weiterlesen

Mit generativer KI erlebt 'Right Brain AI', also eine KI, die kreative Fähigkeiten der rechten menschlichen Gehirnhälfte nachahmt, derzeit einen rasanten Aufstieg. Dieser öffnet aber auch die Tür für einen breiteren Einsatz von eher analytischer 'Left Brain AI'. Das zeigt eine aktuelle Studie von Pegasystems.‣ weiterlesen

Um klima- und ressourcengerechtes Bauen voranzubringen, arbeiten Forschende der Bergischen Universität Wuppertal in ihrem Projekt TimberConnect an der Optimierung von digitalen Prozessen entlang der Lieferkette von Holzbauteilen. Ihr Ziel ist unter anderem, digitale Produktpässe zu erzeugen.‣ weiterlesen

Rund zwei Drittel der Erwerbstätigen in Deutschland verwenden ChatGPT und Co. zumindest testweise, 37 Prozent arbeiten regelmäßig mit KI-Anwendungen. Doch auch Cyberkriminelle machen sich vermehrt die Stärken künstlicher Intelligenz zunutze - mit weitreichenden Folgen.‣ weiterlesen

Erstmals seit der Energiekrise verzeichnet der Energieeffizienz-Index der deutschen Industrie mit allen drei Teilindizes (die Bedeutung, Produktivität und Investitionen betreffend) einen leichten Rückgang. Mögliche Gründe erkennt EEP-Institutsleiter Professor Alexander Sauer in der Unsicherheit und der drohenden Rezession, der dadurch getriebenen Prioritätenverschiebung und der Reduktion von Produktionskapazität.‣ weiterlesen